이번주 AI 뉴스 📰

구글 AI 초기 맴버, "AI 열풍 올라타려 박사 과정? 이미 늦었다"

박사 학위의 실효성 : 구글 생성 AI팀 창립 멤버, Jad Tarifi는 지금 AI 열풍에 편승하려 박사 과정을 시작하면, 졸업할 때쯤엔 핵심 문제가 해결돼 있을 것이라 경고했음.

기회비용 : 5년 이상을 희생하는 박사 과정보다 빠르게 변하는 현실 세계에서 직접 경험하며 더 많이 배우고 적응하는 것이 유리하다고 조언함.

미래 핵심 역량 : AI 시대에는 기술적 지식보다 공감 능력과 사회성 같은 내면적 역량이 AI를 효과적으로 사용하는 데 더 중요해질 것이라고 강조했음.

앤트로픽 'Claude', 유해한 대화 스스로 중단… 'AI 복지' 위해

대화 중단 기능 : 앤트로픽의 최신 AI 모델 '클로드'가 지속적으로 유해하거나 학대적인 대화 시 스스로 대화를 종료하는 기능을 도입했음.

AI 복지 보호 : 이는 사용자가 아닌 AI 모델의 '복지'를 보호하기 위한 조치로, 유해한 요청에 모델이 '고통'을 보이는 패턴을 보였기 때문임.

최후의 수단 : 이 기능은 대화 유도 실패 시 극단적인 경우에만 사용되며, 사용자는 대화 종료 후에도 새 채팅을 시작할 수 있음.

AI 버블 인정 : OpenAI CEO 샘 알트먼이 현재 AI 시장에 투자자들이 과도하게 열광하고 있으며, 이는 닷컴 버블과 유사한 거품 상태라고 진단했음.1

중요성은 여전 : 하지만 버블 현상과 별개로 AI는 아주 오랜만에 등장한 가장 중요한 기술이라는 점 또한 변함없는 사실이라고 강조했음.

공격적인 투자 : OpenAI는 막대한 매출에도 여전히 비영리 상태지만, 약 5천억 달러의 기업 가치로 대규모 주식 매각을 준비하는 등 투자는 계속 유치하고 있음.

이번주 AI 논문 📝

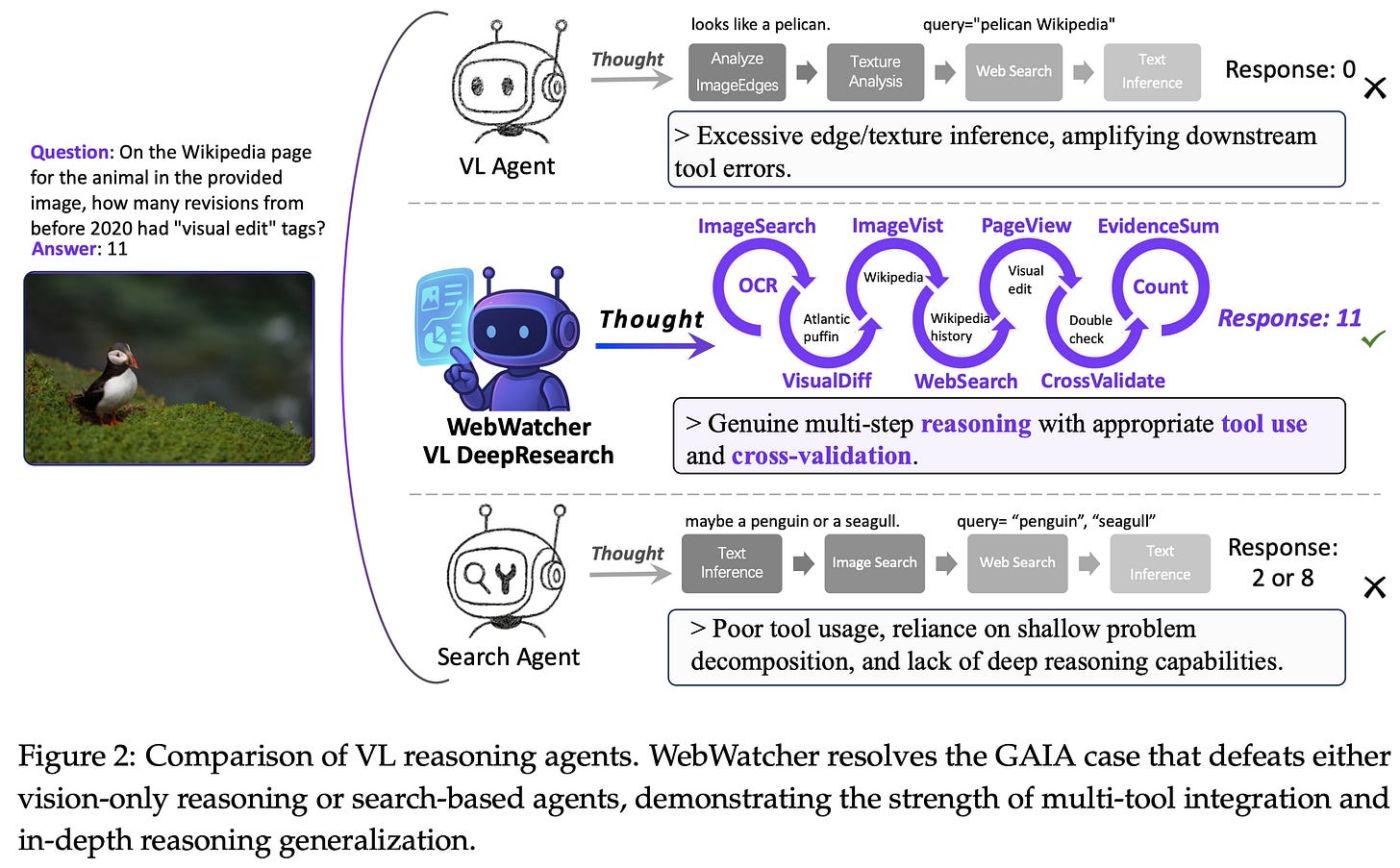

WebWatcher: 시각 정보를 활용하는 딥 리서치 에이전트

시각 정보 활용 에이전트 : 기존의 딥 리서치 웹 에이전트가 텍스트 정보에만 의존하는 한계를 지적하고, 시각과 언어 정보를 모두 활용하는 멀티모달 에이전트 'WebWatcher'를 제안함.

학습 및 추론 방법론 : 고품질 합성 데이터를 통한 초기 학습, 심층 추론을 위한 다양한 도구 사용, 일반화 성능 향상을 위한 강화학습(RL)을 결합하여 에이전트를 구축함.

성능 평가 및 결과 : 멀티모달 에이전트 평가를 위해 자체 벤치마크 'BrowseComp-VL'을 개발했으며, 실험 결과 WebWatcher는 4개의 VQA 벤치마크에서 기존 모델들을 크게 능가하는 성능을 보임.

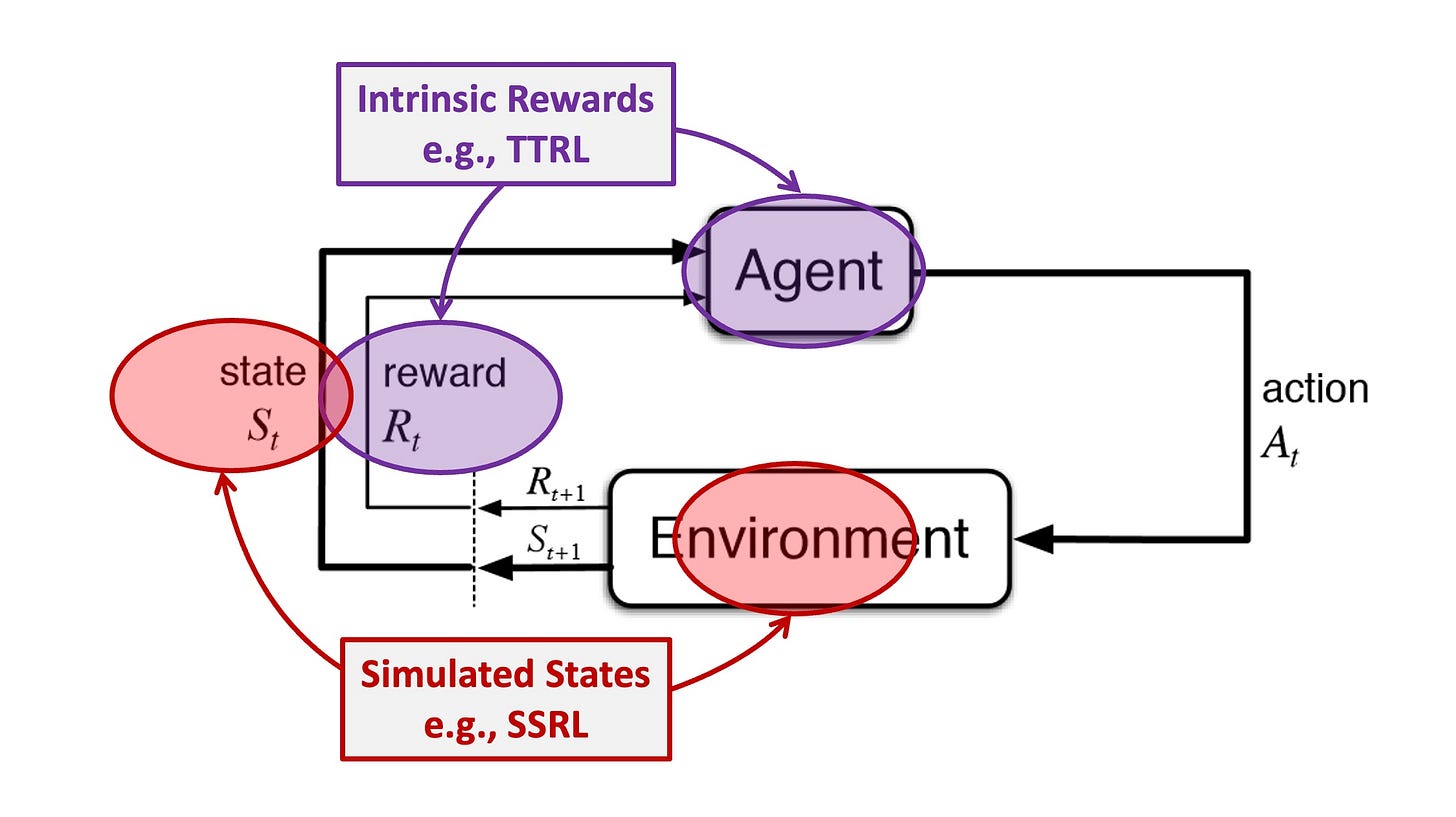

SSRL: 자기-탐색 강화학습 (Self-Search Reinforcement Learning)

LLM 내부 지식 탐색 : 강화학습(RL) 에이전트가 외부 검색 엔진에 의존하는 비용 문제를 해결하고자, LLM이 외부 도구 없이 자신의 내부 지식을 스스로 탐색하는 '자기-탐색(Self-Search)' 개념을 제안함.

RL을 통한 능력 강화 : 이 자기-탐색 능력을 더욱 향상시키기 위해, 형식 및 규칙 기반 보상을 활용하는 강화학습 방법론 'SSRL'을 개발함. 이를 통해 모델은 내부적으로 지식 활용법을 반복적으로 개선함.

결과 및 주요 시사점 : SSRL로 훈련된 모델은 외부 검색 엔진 의존도를 줄이고 환각을 감소시키는 효과를 보였으며, 필요시 추가 작업 없이 외부 검색 엔진과 원활하게 통합될 수 있음을 확인함.

매트릭스-3D(Matrix-3D): 전방향 탐험 가능 3D 월드 생성

파노라마 기반 3D 월드 : 기존 3D 월드 생성 기술의 제한된 범위를 극복하고자, 파노라마 표현을 활용하여 넓은 범위의 전방향 탐험이 가능한 3D 월드 생성 프레임워크 'Matrix-3D'를 제안함.

영상 생성 후 3D 변환 : 기하학적으로 일관된 고품질 파노라마 영상을 먼저 생성한 뒤, 이를 빠르거나 혹은 정밀한 두 가지 방식의 3D 재구성 파이프라인을 통해 3D 월드로 변환함.

대규모 데이터셋 구축 : 효과적인 훈련을 위해 11.6만 개의 고품질 파노라마 영상으로 구성된 대규모 데이터셋 'Matrix-Pano'를 직접 구축했으며, 실험 결과 최고 수준(SOTA)의 성능을 달성함.

이번주 AI 프로덕트 🎁

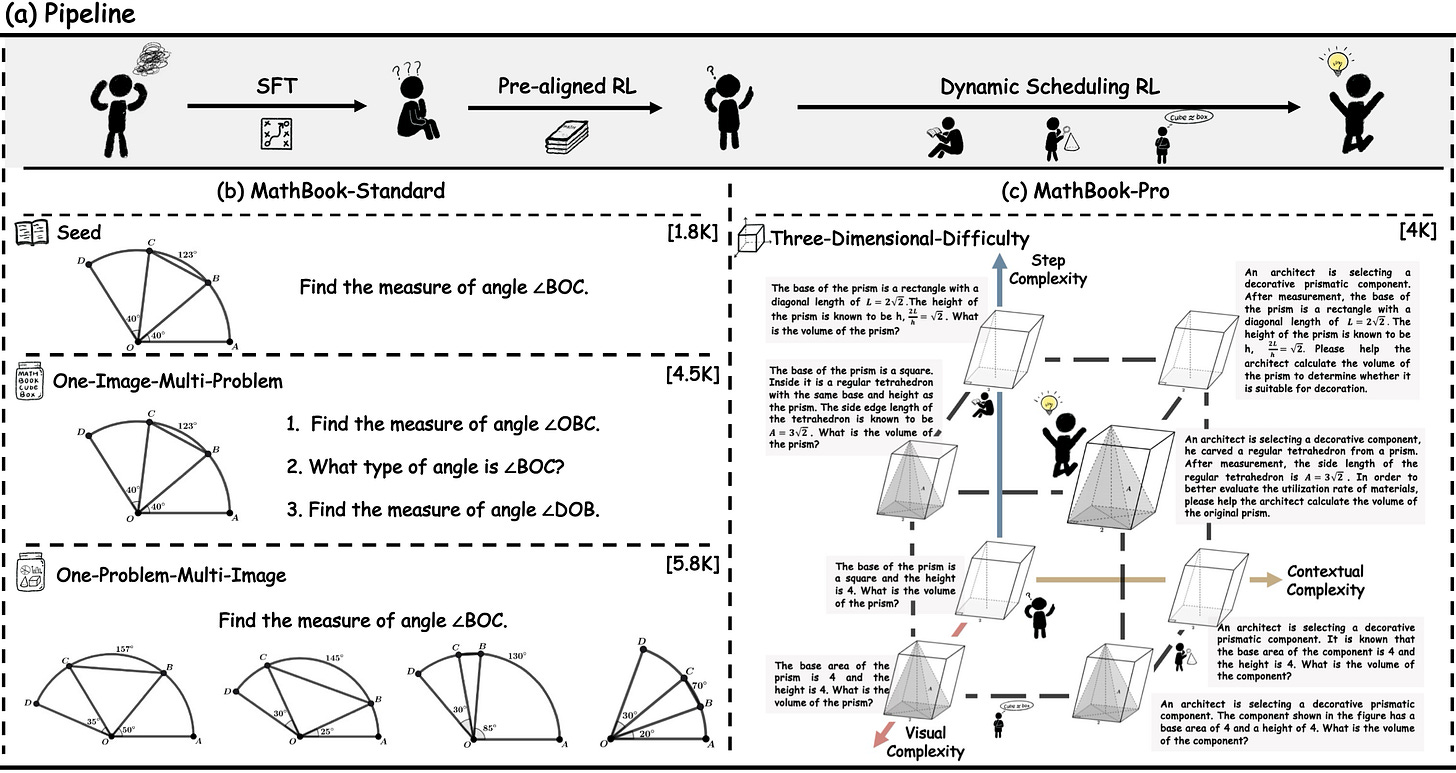

위-매스(We-Math) 2.0: 수학 추론 능력 향상을 위한 통합 시스템

체계적 수학 지식 주입 : 기존 MLLM이 복잡한 수학 추론에 취약한 문제를 해결하고자, 491개의 지식 포인트로 구성된 체계적인 수학 지식 시스템 'MathBook'을 구축함.

단계별 학습과 RL : 이 지식 체계를 바탕으로 기본(Standard) 및 심화(Pro) 데이터셋을 만들고, 2단계 강화학습(RL) 훈련법을 통해 모델이 점진적으로 어려운 문제를 해결하도록 학습시킴.

성능 및 일반화 능력 : 자체 개발한 종합 벤치마크(MathBookEval)와 기존 벤치마크에서 모두 우수한 성능을 보여, 뛰어난 수학 추론 일반화 가능성을 입증함.

넥스트스텝-1(NextStep-1): 연속 토큰을 사용한 자기회귀 이미지 생성

연속 토큰 직접 처리 : 기존 자기회귀(AR) 이미지 생성 모델이 느린 확산 모델에 의존하거나 양자화 손실을 감수해야 했던 문제를 해결하고자, 연속적인 이미지 토큰을 직접 예측하는 새로운 방식을 제안함.

넥스트스텝-1 모델 : 이를 위해 14B 규모의 자기회귀 모델과 157M 크기의 플로우 매칭 헤드를 결합한 'NextStep-1'을 개발했으며, 텍스트와 연속 이미지 토큰을 통합된 방식으로 학습시킴.

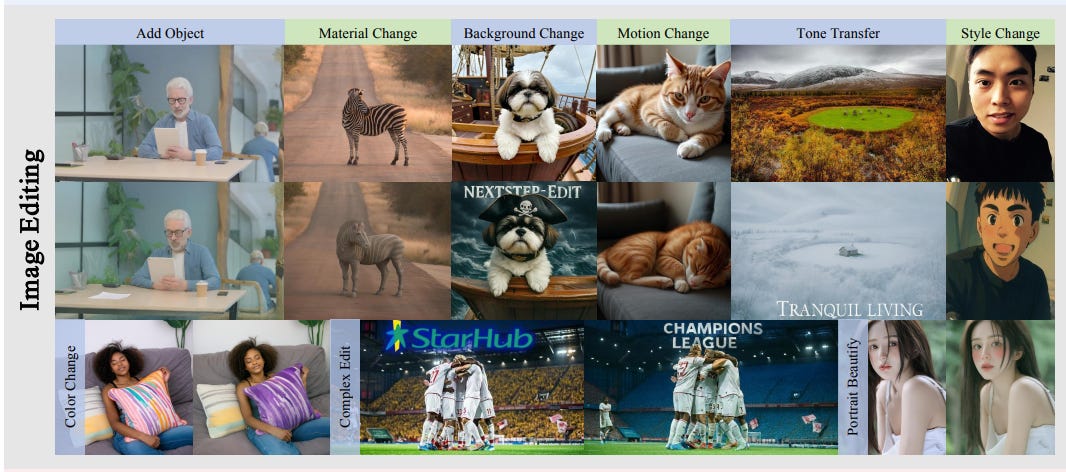

SOTA 및 모델 공개 : NextStep-1은 텍스트-이미지 생성 분야의 자기회귀 모델 중 최고 수준(SOTA) 성능을 달성했으며, 이미지 편집에서도 뛰어난 능력을 보임. 코드와 모델은 커뮤니티에 공개될 예정임.

Share this post