이번주 AI 뉴스 📰

Anthropic, 중국 AI 기업들의 ‘Claude’ 기술 무단 도용 고발

기술 무단 도용 : 딥시크 등 중국 AI 연구소 3곳이 2만4천 개의 가짜 계정을 동원해 ‘Claude’의 핵심 기술을 무단으로 추출(증류)함.

안보 위협 가중 : 안전장치가 배제된 모델 복제로 인해 국가 안보 위험이 커지고 있으며, 이는 미국의 AI 수출 통제 무력화로 이어짐.

방어 및 대응 : Anthropic은 자체적인 감지 및 접근 제어 시스템을 강화하고, AI 업계와 정책 입안자들의 즉각적인 공동 대응을 촉구함.

OpenAI, 기업용 AI 시장 확대를 위해 글로벌 컨설팅 4사와 동맹 결성

컨설팅 동맹 : OpenAI가 기업용 AI 플랫폼 도입을 가속화하기 위해 대형 컨설팅 4개 사와 다년간의 파트너십을 체결함.

업무 구조 혁신 : 기업들이 기존 업무에 AI를 단순 추가하는 것을 넘어, 전략과 프로세스 전반을 개편하도록 지원할 예정임.

기업 시장 공략 : 부진했던 기업들의 AI 도입률과 투자 대비 수익(ROI) 문제를 극복하고 2026년 기업용 시장을 선점하기 위한 전략임.

Sam Altman, “인간도 막대한 에너지를 쓴다”… AI 환경 파괴 논란 반박

물 소비 괴담 : 과거 데이터센터 냉방 방식으로 인한 AI의 과도한 물 소비 논란은 현재 전혀 사실이 아니라고 일축함.

불공평한 잣대 : AI 훈련 에너지만 문제 삼는 것은 불공평하며, 인간도 지능을 갖추기 위해 20년 이상 막대한 에너지를 소비한다고 지적함.

에너지 효율 : 훈련이 완료된 AI와 인간이 단일 질문에 답할 때 소비하는 에너지를 비교하면, 이미 AI가 인간 수준의 효율성을 달성했다고 주장함.

이번주 AI 논문 📝

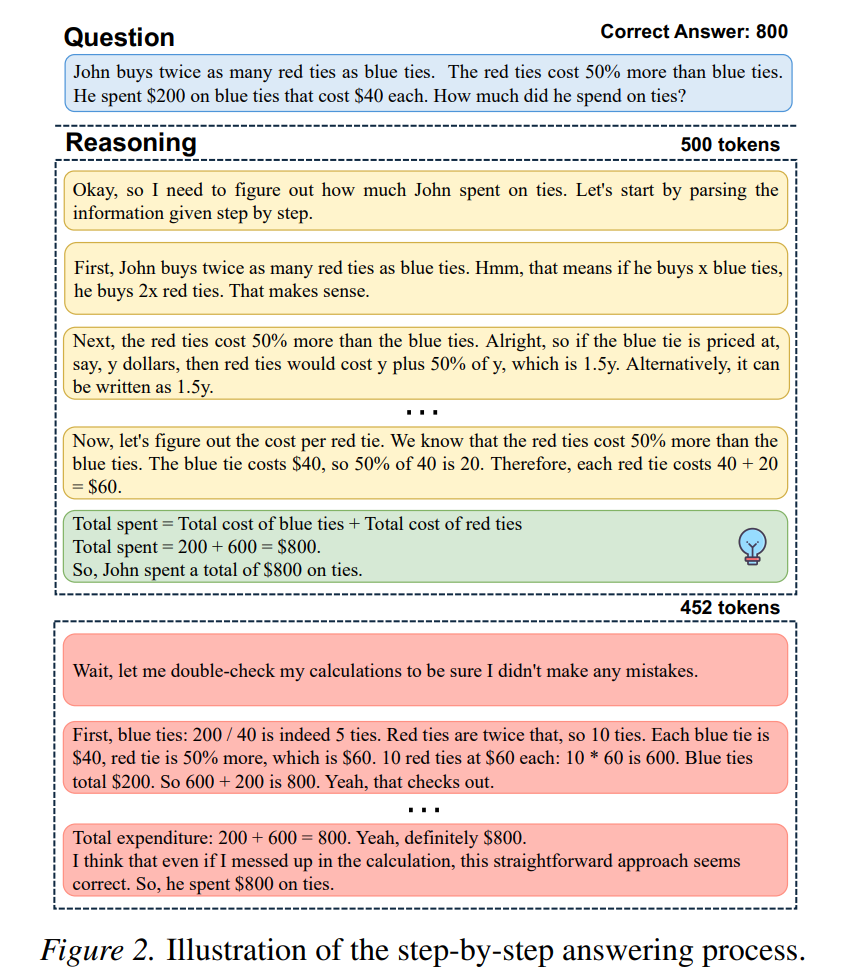

생각이 길어질 때의 부작용 : AI가 복잡한 문제를 풀 때 생각하는 과정을 길게 늘리면 성능은 좋아지지만, 불필요한 연산이 늘어나 처리 속도가 느려지고 오히려 정답을 틀리는 부작용이 생김.

스스로 멈출 때를 아는 AI : 사실 AI는 정답을 찾았을 때 스스로 '생각을 멈출 타이밍'을 이미 알고 있다는 것을 밝혀내고, AI가 스스로 판단해 불필요한 생각을 끝내도록 돕는 새로운 방식(SAGE)을 개발함.

똑똑하고 빠른 추론 완성 : 이 새로운 방식을 AI 훈련 과정에 적용해본 결과, 까다로운 수학 문제들을 풀 때 AI가 정답은 훨씬 더 잘 맞히면서도 생각하는 시간과 자원 소모는 대폭 줄여 빠르고 정확한 일 처리가 가능해짐

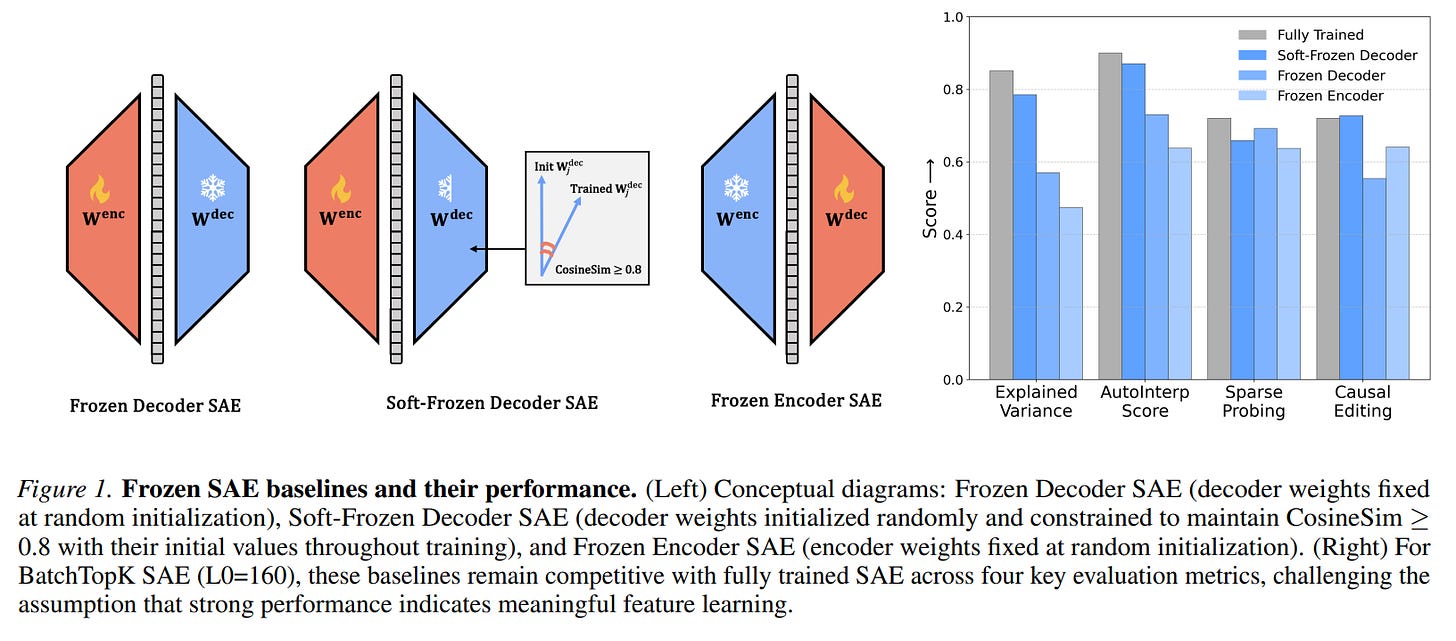

AI 해석 도구 의문 : 복잡한 인공지능의 내부 작동 원리를 파악하기 위한 도구로 SAE가 쓰였으나, 실제로 의미 있는 정보를 추출하는지에 대한 의구심이 커짐.

무작위 대조군 비교 : 정답이 있는 가상 데이터로 검증을 진행하고, 주요 값을 무작위로 고정한 단순 대조군 모델들과 실제 작업 성능을 비교 평가함.

실제 성능 한계점 : 가상 환경에서 진짜 정보의 9%만 복원했고 무작위 대조군과 성능 차이도 거의 없어, 현재로서는 인공지능 내부를 정확히 분석하기 어려움을 확인함.

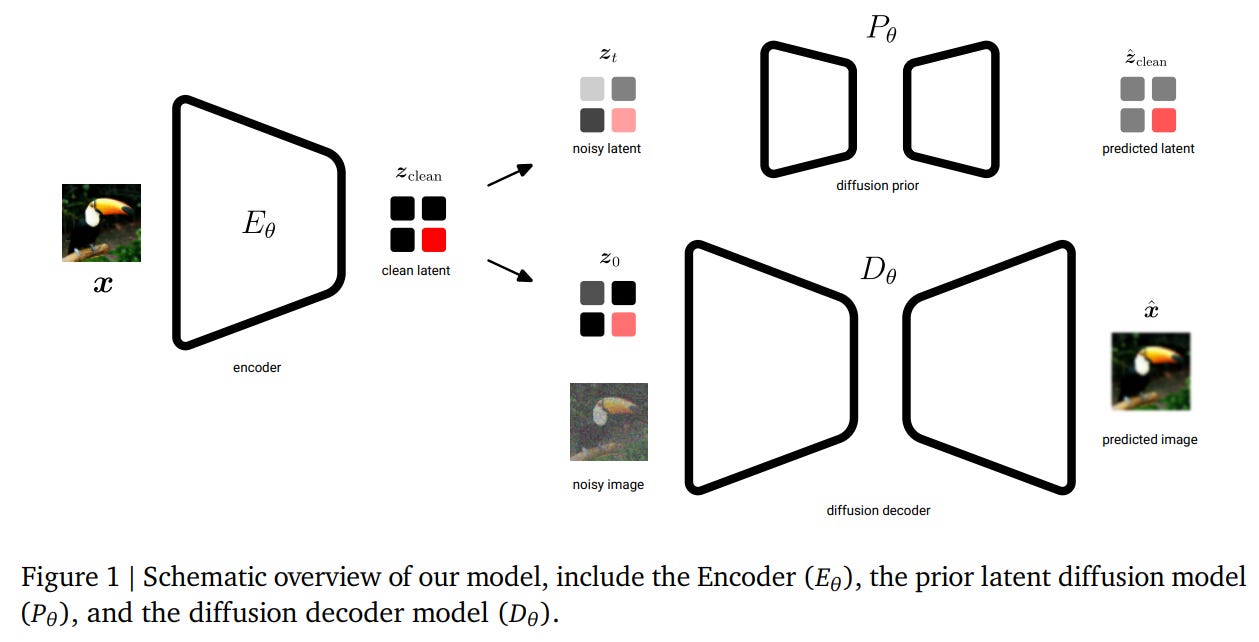

고품질 AI 생성 모델을 위한 효율적인 데이터 압축 및 학습 기법

새로운 압축 방식 : 복잡한 데이터를 작게 압축하고 다루기 위해, 여러 AI 모델이 유기적으로 협력하며 학습하는 새로운 프레임워크를 제안함.

정밀한 노이즈 제어 : 데이터 압축 시 발생하는 노이즈를 정교하게 조절하여, 불필요한 낭비를 줄이고 데이터의 핵심 정보만을 안정적으로 보존함.

압도적 고품질 생성 : 기존 방식보다 적은 연산량만으로도 사진과 영상 생성 평가에서 세계 최고 수준의 선명하고 자연스러운 결과물을 만들어냄.

이번주 AI 프로덕트 🎁

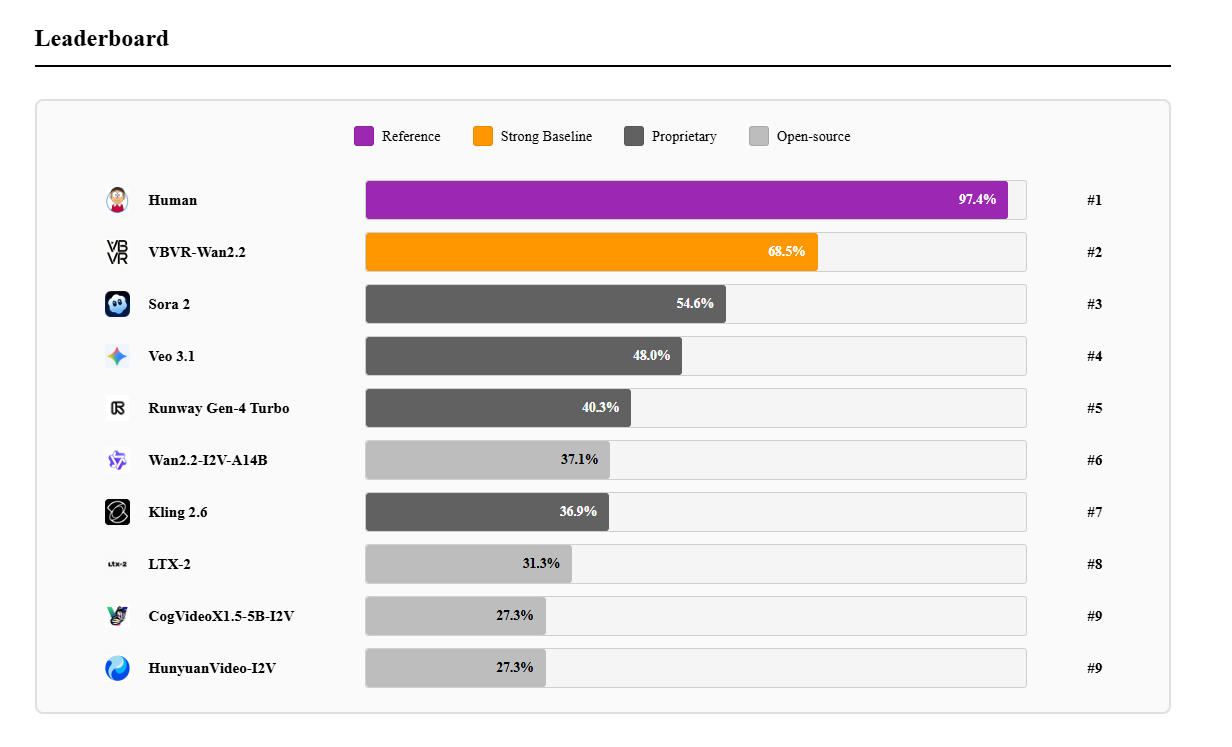

학습 자료의 부족 : 기존 AI는 영상을 진짜처럼 그럴싸하게 만드는 데만 치중하여, 영상 속 상황이나 인과관계를 스스로 생각하고 파악할 수 있도록 돕는 방대한 학습 자료가 턱없이 부족했음.

초대형 자료의 구축 : 이 한계를 깨고자 200가지 미션과 100만 개 이상의 영상을 모은 초대형 학습 자료를 만들고, AI의 이해력을 사람의 기준에 맞춰 정확히 채점하는 새로운 평가 시스템을 도입함.

놀라운 응용력 확인 : 이 방대한 자료로 AI를 훈련해 본 결과, AI가 처음 접하는 낯선 상황에서도 스스로 규칙을 깨닫고 문제를 응용하여 푸는 능력을 보이기 시작해 더 똑똑한 영상 AI의 기반을 마련함.

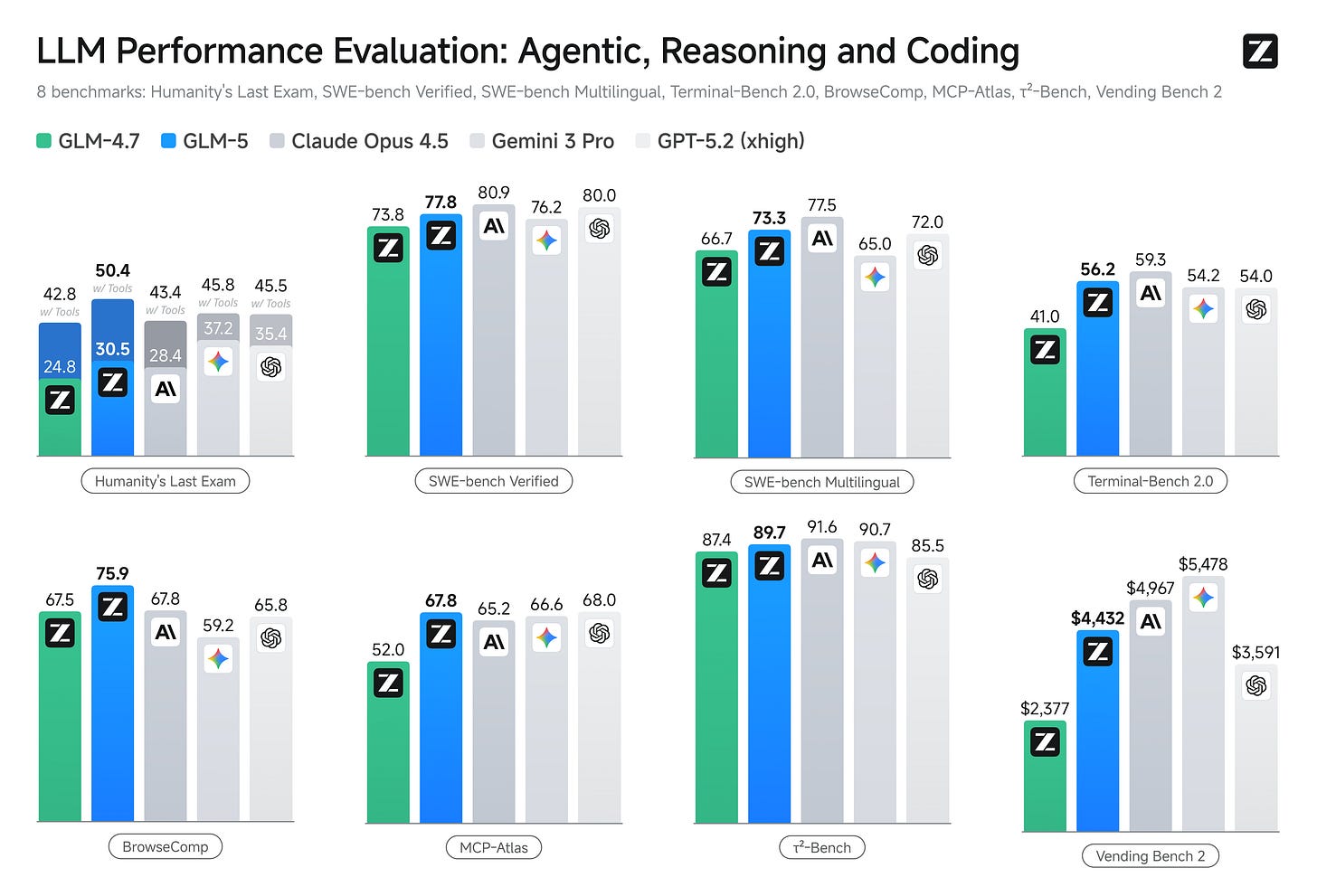

GLM-5: 단순 코딩 보조에서 스스로 일하는 AI로의 진화

AI의 진화 : 사람이 일일이 지시하던 방식에서 벗어나, AI가 스스로 계획을 세우고 전체 프로그램을 완성하는 새로운 모델을 개발함.

효율적 학습 : 불필요한 계산을 줄여 컴퓨터 비용을 아끼고 , 훈련 과정을 효율적으로 분리하는 새로운 기법을 도입해 AI가 더 빠르고 똑똑하게 학습하도록 만듦.

뛰어난 실력 : 주요 AI 성능 평가에서 최고 수준을 기록했으며 , 현실의 복잡한 소프트웨어 개발 업무를 처음부터 끝까지 스스로 해결하는 압도적인 능력을 보여줌.